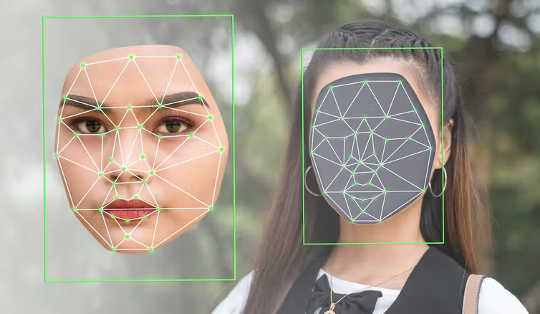

Technologie, die Deepfakes erzeugen kann, ist weit verbreitet. (Shutterstock)

Anfang März, a Manipuliertes Video des ukrainischen Präsidenten Wolodymyr Selenskyj kursierte. Darin forderte ein digital generierter Zelenskyy die ukrainische Nationalarmee auf, sich zu ergeben. Das Video wurde online verbreitet, aber schnell als Deepfake entlarvt – ein hyperrealistisches, aber gefälschtes und manipuliertes Video, das mit künstlicher Intelligenz produziert wurde.

Während russische Desinformation nur begrenzte Auswirkungen zu haben scheint, veranschaulicht dieses alarmierende Beispiel die möglichen Folgen von Deepfakes.

Deepfakes werden jedoch erfolgreich in unterstützenden Technologien eingesetzt. Zum Beispiel, Menschen, die an der Parkinson-Krankheit leiden, können das Klonen von Stimmen zur Kommunikation verwenden.

Deepfakes werden in der Bildung verwendet: Das in Irland ansässige Sprachsyntheseunternehmen CereProc hat eine synthetische Stimme für John F. Kennedy erstellt, ihn wieder zum Leben erwecken, um seine historische Rede zu halten.

Doch jede Medaille hat zwei Seiten. Deepfakes können hyperrealistisch sein und Für das menschliche Auge im Grunde nicht wahrnehmbar.

Daher könnte dieselbe Voice-Cloning-Technologie für Phishing, Verleumdung und Erpressung verwendet werden. Wenn Deepfakes bewusst eingesetzt werden, um die öffentliche Meinung zu verändern, soziale Konflikte zu schüren und Wahlen zu manipulieren, haben sie das Potenzial, die Demokratie zu untergraben.

Forscher der University of Washington haben einen Deepfake von Barack Obama erstellt.

Chaos verursachen

Deepfakes basieren auf einer Technologie, die als bekannt ist generative kontradiktorische Netzwerke bei dem sich zwei Algorithmen gegenseitig trainieren, Bilder zu erzeugen.

Während die Technologie hinter Deepfakes kompliziert klingen mag, ist es einfach, eine solche herzustellen. Es gibt zahlreiche Online-Anwendungen wie z Gesichtstausch und ZAO Deepswap die Deepfakes innerhalb von Minuten produzieren kann.

Google Colaboratory – ein Online-Repository für Code in mehreren Programmiersprachen – enthält Codebeispiele, die kann verwendet werden, um gefälschte Bilder und Videos zu generieren. Bei einer so zugänglichen Software ist es leicht zu erkennen, wie durchschnittliche Benutzer mit Deepfakes Chaos anrichten können, ohne die potenziellen Sicherheitsrisiken zu erkennen.

Die Popularität von Face-Swapping-Apps und Online-Diensten wie Tiefe Nostalgie zeigen, wie schnell und umfassend Deepfakes von der breiten Öffentlichkeit angenommen werden könnten. 2019, Etwa 15,000 Videos mit Deepfakes wurden entdeckt. Und diese Zahl soll weiter steigen.

Deepfakes sind das perfekte Werkzeug für Desinformationskampagnen, da sie glaubwürdige Fake News produzieren, deren Entlarvung einige Zeit in Anspruch nimmt. Inzwischen sind die durch Deepfakes verursachten Schäden – insbesondere solche, die den Ruf der Menschen beeinträchtigen – oft langanhaltend und irreversibel.

DeepSwap ist eine gute Wahl für alle, die mit minimalem Aufwand überzeugende Deepfakes erstellen möchten. ??t;a href="https://twitter.com/hashtag/DeepSwap?src=hash&ref_src=twsrc%5Etfw">#DeepSwap #FaceSwap #DeepFake #FaceApp #Rückblick #Überprüfung #Bewertungen #Künstliche Intelligenz #Ai #tech # Technologie #TechNews #TechnologyNews #MENA #TechMGZNhttps://t.co/A2Cbp02sH1

– Tech-Magazin (@TechMGZN) 4. Mai 2022

Ist Sehen Glauben?

Die vielleicht gefährlichste Auswirkung von Deepfakes ist, wie sie sich für Desinformation in politischen Kampagnen eignen.

Wir haben dies gesehen, als Donald Trump jede wenig schmeichelhafte Berichterstattung in den Medien als „gefälschte Nachrichten.“ Indem er seine Kritiker beschuldigte, gefälschte Nachrichten zu verbreiten, war Trump in der Lage, Fehlinformationen zur Verteidigung seines Fehlverhaltens und als Propagandainstrument einzusetzen.

Trumps Strategie ermöglicht es ihm, Unterstützung in einem Umfeld voller Misstrauen und Desinformation aufrechtzuerhalten, indem er behauptet: „dass wahre Ereignisse und Geschichten Fake News oder Deepfakes sind"

Die Glaubwürdigkeit bei Behörden und Medien wird untergraben, ein Klima des Misstrauens schaffen. Und mit der zunehmenden Verbreitung von Deepfakes könnten Politiker die Schuld an aufkommenden Skandalen leicht leugnen. Wie kann die Identität einer Person in einem Video bestätigt werden, wenn sie sie abstreitet?

Die Bekämpfung von Desinformation war jedoch schon immer eine Herausforderung für Demokratien, da sie versuchen, die Meinungsfreiheit zu wahren. Mensch-KI-Partnerschaften können dazu beitragen, das steigende Risiko von Deepfakes zu bewältigen, indem Menschen Informationen überprüfen lassen. Auch die Einführung neuer Gesetze oder die Anwendung bestehender Gesetze zur Bestrafung von Herstellern von Deepfakes für die Fälschung von Informationen und die Nachahmung von Personen könnte in Erwägung gezogen werden.

Multidisziplinäre Ansätze von internationalen und nationalen Regierungen, Privatunternehmen und anderen Organisationen sind unerlässlich, um demokratische Gesellschaften vor falschen Informationen zu schützen.![]()

Über den Autor

Sze-Fung Lee, Wissenschaftlicher Mitarbeiter, Institut für Wirtschaftsinformatik, McGill University und Benjamin CM Fung, Professor und kanadischer Forschungslehrstuhl für Data Mining für Cybersicherheit, McGill University

Dieser Artikel wird erneut veröffentlicht Das Gespräch unter einer Creative Commons-Lizenz. Lies das Original Artikel.