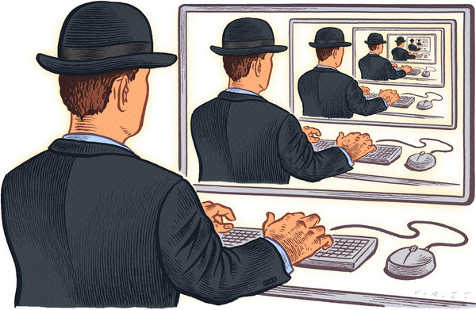

Wo auch immer Sie online gehen, versucht jemand, Ihre Web-Erfahrung zu personalisieren. Ihre Präferenzen werden vorweggenommen, Ihre Absichten und Motivationen vorhergesagt. Der Toaster, den Sie vor drei Monaten kurz angeschaut haben, kehrt immer wieder zurück, um Ihr Surfen in maßgeschneiderten Werbeseiten zu verfolgen. Und es ist keine Einbahnstraße. Tatsächlich kann die ziemlich unpersönliche Mechanik einiger Personalisierungssysteme nicht nur beeinflussen, wie wir die Welt sehen, sondern auch, wie wir uns selbst sehen.

Es passiert jeden Tag, während wir online sind. Facebooks Newsfeed versucht, maßgeschneiderte Inhalte zu liefern, die "Die meisten Interessen" einzelne Benutzer. Die Empfehlungs-Engine von Amazon verwendet das Tracking persönlicher Daten in Kombination mit den Surfgewohnheiten anderer Nutzer relevante Produkte. Google Personalisiert Suchergebnisseund vieles mehr: zum Beispiel Personalisierungs-App Google Now sucht, "Ihnen die Informationen zu geben, die Sie während Ihres Tages benötigen, bevor Sie sogar fragen". Solche Personalisierungssysteme zielen nicht nur darauf ab, Relevanz für Benutzer bereitzustellen; durch zielgerichtete marketing-strategien generieren sie auch gewinn für viele frei nutzbare web-services.

Vielleicht die bekannteste Kritik an diesem Prozess ist die "Filterblase" Theorie. Vorgeschlagen von Internet-Aktivist Eli PariserDiese Theorie legt nahe, dass die Personalisierung die Erfahrungen von Webbenutzern beeinträchtigen kann. Anstatt den universellen, vielfältigen Inhalten ausgesetzt zu sein, wird den Nutzern algorithmisch geliefertes Material zur Verfügung gestellt, das zu ihren bereits bestehenden, selbstbejahenden Standpunkten passt. Die Filterblase stellt daher ein Problem für das demokratische Engagement dar: Indem der Zugang zu anspruchsvollen und unterschiedlichen Standpunkten eingeschränkt wird, können die Nutzer nicht an einer kollektiven und sachkundigen Debatte teilnehmen.

{youtube}6_sim_Wc3mY{/youtube}

Versuche, Beweise für die Filterblase zu finden, haben zu gemischten Ergebnissen geführt. Einige Studien haben gezeigt, dass Personalisierung tatsächlich zu einer "kurzsichtigen" Sicht auf ein Thema führen kann; andere Studien haben herausgefunden, dass Personalisierung in verschiedenen Kontexten den Nutzern helfen kann, gemeinsame und vielfältige Inhalte zu entdecken. Meine Forschung legt nahe, dass Personalisierung nicht nur beeinflusst, wie wir die Welt sehen, sondern wie wir uns selbst sehen. Der Einfluss von Personalisierung auf unsere Identitäten ist möglicherweise nicht darauf zurückzuführen, dass Konsumblasen gefiltert werden, sondern weil Online-Personalisierung in manchen Fällen nicht sehr "persönlich" ist.

Datenverfolgung und Vorbelegung durch den Benutzer

Um dies zu verstehen, ist es nützlich zu überlegen, wie Online-Personalisierung erreicht wird. Obwohl Personalisierungssysteme unsere individuellen Webbewegungen verfolgen, sind sie nicht dazu gedacht, uns als Individuen zu "kennen" oder zu identifizieren. Stattdessen erfassen diese Systeme die Echtzeitbewegungen und -gewohnheiten der Benutzer in Massendatensätzen und suchen nach Mustern und Korrelationen zwischen den Bewegungen der Benutzer. Die gefundenen Muster und Korrelationen sind dann übersetzt zurück in Identitätskategorien, die wir erkennen könnten (wie Alter, Geschlecht, Sprache und Interessen) und in die wir passen könnten. Indem nach Massenmustern gesucht wird, um persönlich relevante Inhalte zu liefern, basiert die Personalisierung tatsächlich darauf ein eher unpersönlicher Prozess.

Als die Filterblastentheorie in 2011 zum ersten Mal auftauchte, argumentierte Parisner, dass eines der größten Probleme bei der Personalisierung darin bestünde, dass die Benutzer nicht wussten, dass es passierte. Heutzutage, trotz der Einwände gegen die Datenverfolgung, viele Benutzer sind sich dessen bewusst dass sie im Austausch gegen die Nutzung kostenloser Dienste verfolgt werden und dass dieses Tracking für Personalisierungsformen verwendet wird. Weitaus weniger klar sind jedoch die Besonderheiten dessen, was für uns wie und wann personalisiert wird.

Den "persönlichen" finden

Meine Forschungsergebnisse legen nahe, dass einige Benutzer davon ausgehen, dass ihre Erfahrungen auf komplexe Grade zugeschnitten sind. In einer eingehenden qualitativen Studie von 36-Webnutzern berichteten einige weibliche Nutzer, dass sie davon ausgegangen waren, dass Facebook sie als übergewichtig oder fitnessorientiert dargestellt hat. In der Tat wurden diese Gewichtsverlust Anzeigen generisch an Frauen im Alter von 24-30 geliefert. Da die Nutzer sich jedoch der unpersönlichen Natur einiger Personalisierungssysteme nicht bewusst sind, können sich solche gezielten Anzeigen nachteilig auf das Selbstverständnis dieser Nutzer auswirken: Grob gesagt, müssen sie übergewichtig sein, weil Facebook ihnen sagt, dass sie es sind.

Nicht nur zielgerichtete Werbung kann diese Wirkung haben: In einer ethnografischen und längsschnittlichen Studie einiger 18- und 19-Jahre alter Google Now-Nutzer stellte ich fest, dass einige Teilnehmer davon ausgingen, dass die App außergewöhnlich komplex sei . Nutzer gaben an, dass sie glaubten, dass Google Now ihnen Aktieninformationen zeigte, weil Google wusste, dass ihre Eltern Aktionäre waren oder dass Google (fälschlicherweise) eine "Pendelbewegung" vorwegnahm, weil die Teilnehmer einmal gelogen hatten, in ihren YouTube-Konten überschulpflichtig zu sein . Es versteht sich von selbst, dass diese kleine Studie nicht die Engagements aller Google Now-Nutzer widerspiegelt: Sie legt jedoch nahe, dass die vorhersagbaren Versprechen von Google Now für diese Personen fast unfehlbar waren.

In der Tat Kritik am benutzerzentrierten Design deuten darauf hin, dass die Realität der Google-Schlussfolgerungen viel unpersönlicher ist: Google Now geht davon aus, dass dies der Fall ist "Idealer Benutzer" sollte - oder sollte zumindest - ein Interesse an Aktien haben, und dass alle Nutzer Pendler sind. Solche Kritiken zeigen, dass diese Annahmen das Google-Personalisierungs-Framework weitgehend strukturieren (zum Beispiel durch die Einhaltung der App-Richtlinien) vordefinierte "Karten" -Kategorien wie zum Beispiel "Sport", was während meines Studiums nur den Benutzern erlaubte, den britischen Fußballvereinen von Männern anstelle von Frauen zu folgen. Anstatt jedoch die Annahmen der App in Frage zu stellen, schlägt meine Studie vor, dass sich die Teilnehmer außerhalb der erwarteten Norm befinden: Sie vertrauten Google, ihnen zu sagen, wie ihre persönlichen Erfahrungen aussehen sollten.

Obwohl dies als extreme Beispiele für unpersönliche algorithmische Inferenz und Benutzerannahme erscheinen mag, die Tatsache, dass wir nicht sicher sein können, was personalisiert wird, wann oder wie häufigere Probleme sind. Diese Nutzerberichte unterstreichen, dass die Anpassung von Online-Inhalten Auswirkungen hat, die über die Tatsache hinausgehen, dass sie für die Demokratie schädlich sein könnten. Sie legen nahe, dass, wenn wir nicht verstehen, dass Personalisierung manchmal über sehr unpersönliche Rahmenbedingungen funktionieren kann, wir zu viel Vertrauen in die Personalisierung setzen, um uns zu sagen, wie wir uns verhalten sollten und wer wir sein sollten und nicht umgekehrt.

Über den Autor

Tanya Kant, Dozentin für Medien- und Kulturwissenschaften, University of Sussex

Dieser Artikel wurde ursprünglich veröffentlicht am Das Gespräch.. Lies das Original Artikel.

Bücher zum Thema

at InnerSelf Market und Amazon